Il Garante della Privacy qualche giorno fa “ha rilevato la mancanza di una informativa agli utenti e a tutti gli interessati i cui dati vengono raccolti da OpenAI, ma soprattutto l’assenza di una base giuridica che giustifichi la raccolta e la conservazione massiccia di dati personali, allo scopo di “addestrare” gli algoritmi sottesi al funzionamento della piattaforma”.

OpenAI avrebbe dovuto comunicare entro 20 giorni le misure intraprese in attuazione di quanto richiesto dal Garante, pena una sanzione fino a 20 milioni di euro o fino al 4% del fatturato globale annuo.

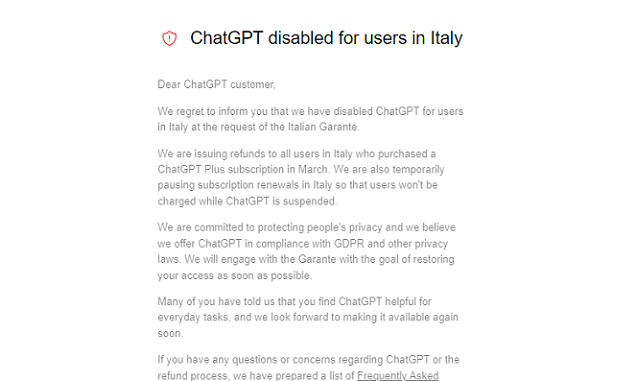

Risposta del CEO di OpenAI: “Noi naturalmente ci rimettiamo al governo italiano e interrompiamo l’attività in Italia (sebbene pensiamo di avere rispettato tutte le leggi sulla privacy)”.

Fin qui la cronaca. In Italia si stanno formando due schieramenti: da una parte chi vede ne Garante della Privacy l’ultimo baluardo difensivo dei propri diritti in un mondo virtuale dove ci troviamo sempre più senza difese. Dall’altra parte chi da ragione a ChatGPT e pensa che nessun decreto possa bloccare l’innovazione tecnologica e che fa finire l’Italia in compagnia di Cina, Russia, Iran e Corea del Nord dove l’uso di ChatGPT non è possibile (anche se per scelta di OpenAI e non dei rispettivi governi).

La ragione, a mio avviso, sta nel mezzo. È ovvio, e ormai dimostrato, che nessun paese da solo possa fermare l’evoluzione tecnologica (basta una VPN per aggirare il blocco) ma è altrettanto vero che se nessuno fa niente niente cambia. Dopo una fuga di dati di ChatGPT dello scorso 20 marzo le preoccupazioni su questo strumento (e sull’intelligenza artificiale in generale) sono aumentate fino alla pubblicazione della lettera aperta online descritta nello scorso articolo. Quello del Garante è una prima risposta a questa lettera e anche se il peso dell’Italia è troppo piccolo per innescare un cambiamento è pur sempre un inizio. Per adesso, ma solo per adesso è tutto, vi do appuntamento al prossimo articolo.

Davide Gambacciani

Leave a Reply